Python爬虫,又称网页蜘蛛网络机器人,是一种按照一定的规则,自动地在互联网上抓取信息的程序或脚本它利用Python语言的脚本特性和丰富的网络抓取模块,实现对网页内容的自动采集和处理二Python爬虫的主要用途 搜索引擎Python爬虫是搜索引擎的重要组成部分,用于抓取网页内容并建立全文索引,以便用户;网络爬虫也称为网络蜘蛛或网络机器人是一种功能强大的自动化程序,可以在互联网上爬取信息,其主要功能包括数据采集网页内容抓取自动从网站上获取网页的源代码和内容产品信息提取抓取电商网站上的商品信息,如价格描述评价等新闻资讯收集从新闻网站上获取最新的新闻报道和资讯搜索引擎。

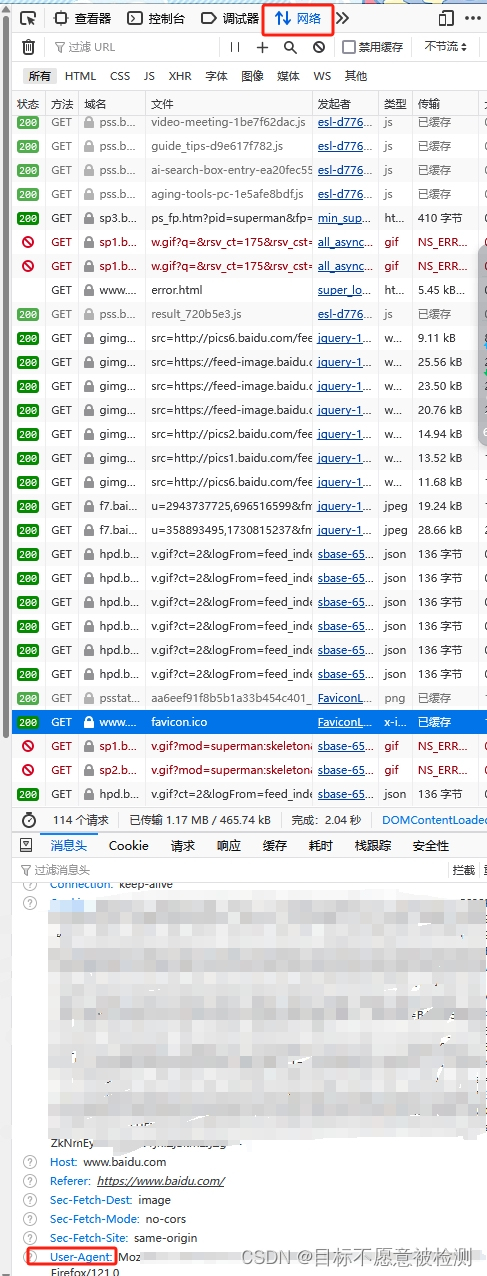

headers包括用户代理等,用于模仿真实浏览器的请求行为,避免被目标网站识别为爬虫而拒绝服务params动态生成请求参数,如页码论坛ID等,以适应不同页面的数据抓取需求发送请求并解析响应使用requestsget方法发送GET请求到目标URL,并传入headers和params解析响应内容,通常响应内容会是JSON格式,使;搜索引擎搜索引擎是爬虫技术最典型的应用场景之一搜索引擎通过爬虫技术抓取互联网上的网页内容,并建立索引,以便用户能够快速找到所需信息数据采集爬虫技术还可以用于数据采集,如抓取商品价格新闻资讯社交媒体数据等,为数据分析提供丰富的数据源网站监控通过定期抓取网站内容,可以监控网站的。

数据工程师中的“爬虫”是指一种自动化的程序,用于在互联网上抓取和获取信息以下是关于数据工程师爬虫的详细解释一爬虫的工作流程 网页抓取爬虫首先会访问指定的网站,并通过;打开要抓取的网页,如豆瓣 Top250,使用快捷键在 Windows 上是 Ctrl+Shift+I,而在 Mac 上是 Option+Command+i进入开发者模式查看网页的 HTML 结构点击 Web Scraper 图标,进入爬虫页面接下来,我们需要根据网页结构创建爬虫首先,创建一个新的。

目录1 PC网页爬虫 2 H5网页爬虫 3 微信小程序爬虫 4 手机APP爬虫 爬取超级猩猩的课表,该平台仅提供了微信小程序这一个途径,前面两种针对html网页的爬取方式都不再适用采用抓包分析是我们制定方案的第一步我用的Mac电脑,fiddler只有一个简化版,所以另找了Charles这个类似的软件启动。

网页爬虫app

一网络爬虫的基本结构及工作流程 一个典型的网络爬虫系统通常包括三个主要部分控制器解析器和资源库控制器负责管理多线程爬虫的工作任务分配,解析器负责下载网页,处理页面内容去除JS脚本标签CSS代码空格HTML标签等,资源库用于存储下载的网页资源,一般采用大型数据库如Oracle存储,并建立索引二互联网。

网络爬虫程序基本概述如下定义网络爬虫程序,也被称为WebCrawler或Robot,是一种自动在互联网上收集信息的程序工作原理爬虫主要驻留在服务器上,通过访问特定URL,利用。

二工作原理 网络爬虫的工作过程可以分为四个主要步骤发送请求接收响应数据解析和存储数据首先,爬虫程序会发送请求到目标网站然后,接收网站的响应,获取网页内容接着,使用解析器对网页数据进行解析和提取最后,将提取的数据存储在本地数据库或文件中三用途和限制 网络爬虫被广泛应用于。

网页爬虫 实例

1、易于配置Python语言具有简洁的语法和丰富的库,使得编写和配置爬虫程序变得相对简单字符处理灵活Python对字符串和文本的处理非常灵活,这在进行网页内容解析时尤为重要丰富的网络抓取模块Python拥有许多强大的网络抓取库,如requestsBeautifulSoupScrapy等,这些库提供了丰富的功能和简便的API,极大地。

2、对于网页中的隐藏内容,如需在鼠标移动至特定链接时展示的数据,可利用爬虫软件识别并抓取这些动态加载的数据通过模拟用户操作,如移动鼠标,爬虫软件能有效获取隐藏信息无限滚动网页的提取需关注网页动态加载机制如今日头条首页,通过不断滚动加载更多文章在爬虫设置中,调整AJAX超时滚动方式和时间。

3、3 配置采集规则可以使用智能识别功能,让八爪鱼自动识别小说网站页面的数据结构,或者手动设置采集规则4 如果手动设置采集规则,可以通过鼠标选择页面上的数据元素,并设置相应的采集规则,以确保正确获取小说的标题作者内容等信息5 设置翻页规则如果小说网站的小说列表需要翻页查看,可以设置八爪鱼采集器自动翻页,以获取更多的。

4、以下是使用八爪鱼采集器进行网页数据爬取的步骤1 打开八爪鱼采集器,并创建一个新的采集任务2 在任务设置中,输入要爬取的网址作为采集的起始网址3 配置采集规则可以使用智能识别功能,让八爪鱼自动识别页面的数据结构,或者手动设置采集规则4 如果手动设置采集规则,可以通过鼠标选择页面上。

5、“UserAgent”检查是另一种反爬机制,通过检查浏览器发送的请求头信息来识别爬虫应对方法是使用亮网络解锁器自动轮换UserAgent,突破此障碍“蜜罐陷阱”策略则在网页源代码中设置虚假链接,诱使爬虫访问可使用亮网络解锁器自动设置特定CSS属性,避免触发陷阱JavaScript加密是另一种保护数据的策略。